La chiave di volta per la realtà virtuale potrebbe risiedere in una tecnologia vecchia di 60 anni: l’olografia.

Gli ologrammi regalano un’eccezionale rappresentazione del mondo 3D e, cosa più importante, offrono una prospettiva mutevole in base alla posizione dello spettatore, consentendo all’occhio di regolare la profondità, mettendo a fuoco alternativamente il primo piano piuttosto che lo sfondo.

Partendo da questo, i ricercatori del Massachusetts Institute of Technology, hanno generato ologrammi 3D in tempo reale avvalendosi di una rete neurale convoluzionale, una tecnica di elaborazione che utilizza una catena di tensori addestrabili, per imitare approssimativamente il modo in cui gli esseri umani elaborano le informazioni visive. In altre parole, hanno generato immagini 3D tramite una simulazione ottica creata grazie all’intelligenza artificiale.

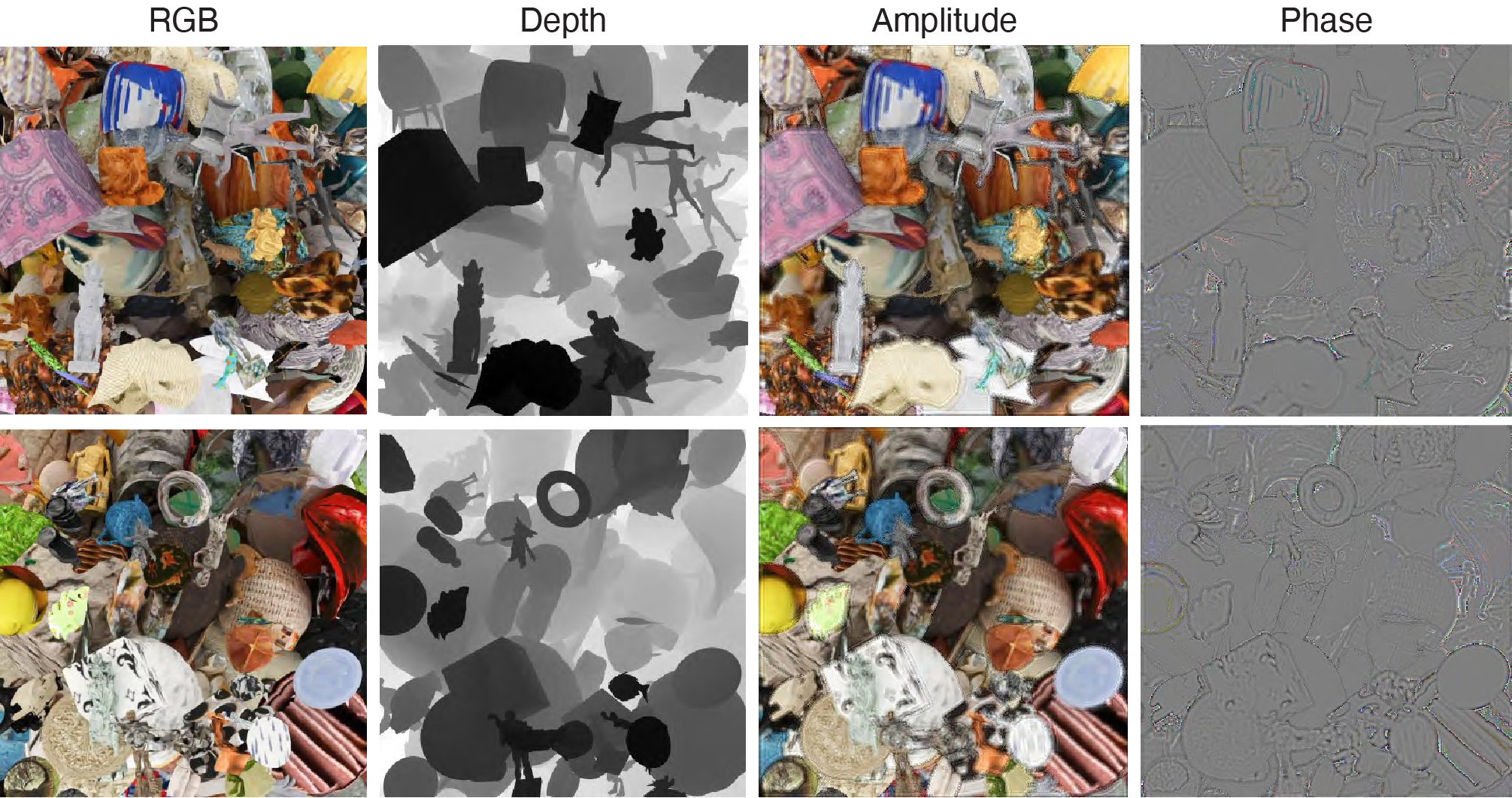

L’addestramento della sopracitata rete neurale è avvenuta attraverso un set di big data creato ad hoc per la ricerca, basato su “scene con forme e colori complessi e variabili”. Il team di ricerca tramite l’utilizzo di 4.000 coppie d’immagini, l’ologramma corrispondente e le informazioni specifiche su colore e profondità delle onde luminose, è riuscito a sviluppare una sorta di configurazione ottica. “Imparando” da ogni coppia di immagini precaricata, la rete ha modificato i propri parametri di calcolo, migliorando così la capacità di generare ologrammi, ottimizzando di volta in volta il risultato finale.

Esempio di immagini contenute nel database usato dai ricercatori

Esempio di immagini contenute nel database usato dai ricercatori

L’efficienza e la velocità raggiunta – pochi millisecondi per ologramma – ha sorpreso gli stessi componenti del team, aprendo molteplici – seppur ipotetici – scenari di applicazione. Joel Kollin, uno dei principali optical architect di Microsoft, anche se non coinvolto nella ricerca, ha suggerito la possibilità di personalizzare queste visualizzazioni in base alla prescrizione oftalmica di uno spettatore, creando così immagini più nitide di quelle che egli sarebbe in grado di vedere con l’utilizzo di occhiali di correzione per aberrazioni di basso ordine.

L’olografia 3D in tempo reale potrebbe migliorare una serie di sistemi, dalla stampa 3D volumetrica, alla microscopia, fino ad arrivare alla VR. Il team, guidato da Liang Shi, autore della ricerca e dottorando presso l’EECS – Dipartimento di ingegneria ed informatica del MIT, ha affermato che questo nuovo sistema potrebbe immergere gli spettatori VR in scenari più realistici, eliminando l’affaticamento agli occhi e gli altri effetti collaterali legati all’uso della realtà virtuale a lungo termine.

La tecnologia potrebbe essere facilmente implementata su display che modulano non solo la luminosità delle onde luminose, ma anche la loro fase e ipoteticamente potrebbe già essere messa a punto per gli ultimi modelli di smartphone. Il lavoro di ricerca è stato supportato in parte anche da SONY.

Per approfondire:

Shi, L., Li, B., Kim, C. et al. (2021) Towards real-time photorealistic 3D holography with deep neural networks. Nature 591, 234–239 https://doi.org/10.1038/s41586-020-03152-0